LEDARE • Det är lätt att avfärda diskussionen om allvarliga risker med AI som överdriven, som ännu en våg av teknikoro inför det nya, som dystopisk science fiction. Men kan man fortsätta med det när varningarna inte längre kommer bara från utomstående kritiker, konspirationsteoretiker och foliehattar – utan från dem som själva skapat tekniken?

I min förra ledare varnade jag för vad som kan hända om vi i västvärlden låter Kina få ett försprång i utvecklingen av artificiell intelligens (AI). Hur allvarligt detta faktiskt vore kanske inte framgick med all önskvärd tydlighet. När allt kommer omkring begriper inte ens våra högsta politiska beslutsfattare vad som väntar runt hörnet. Så här är en klargörande uppföljare.

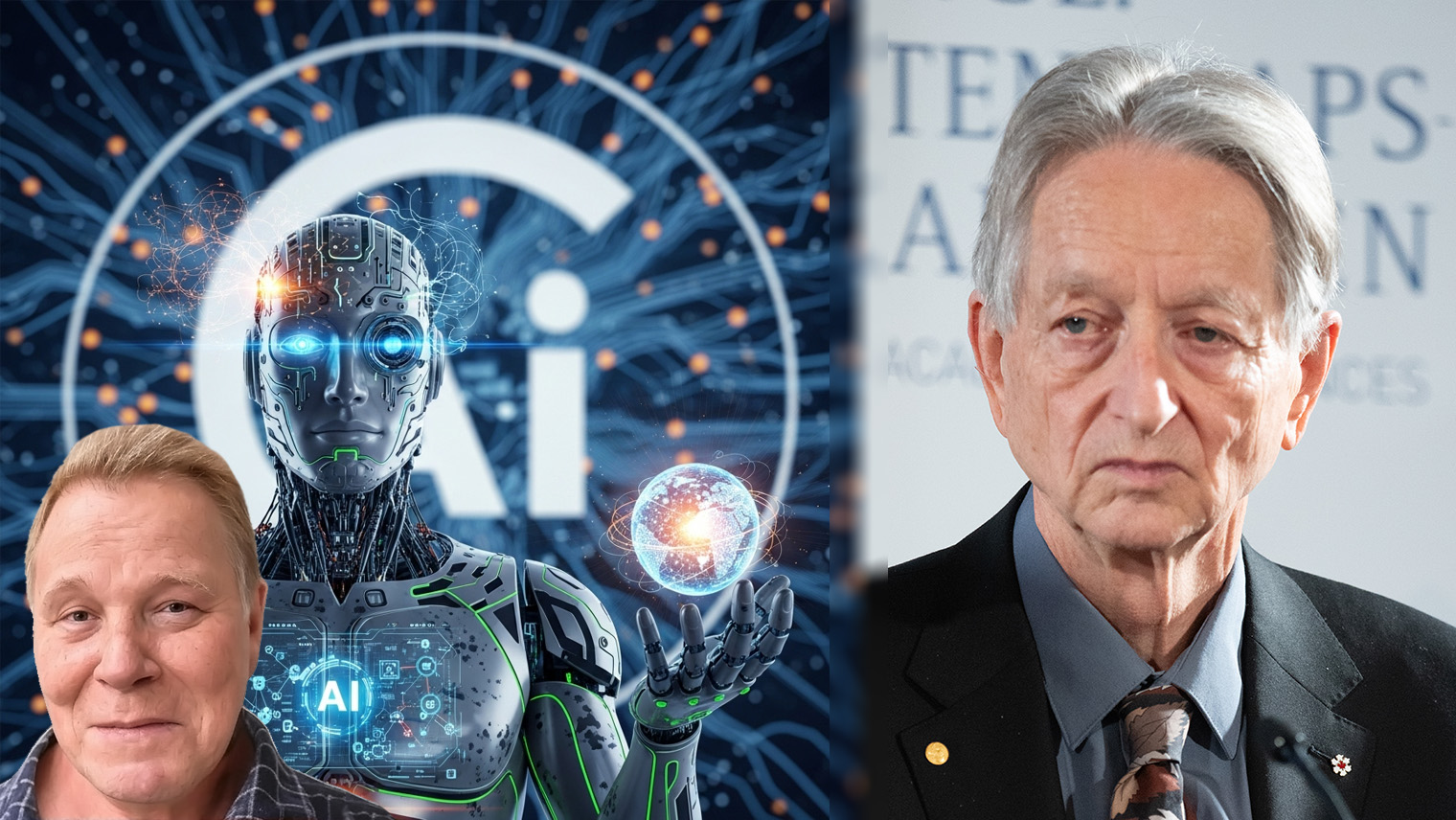

Nobelpristagaren i fysik Geoffrey Hinton, ofta kallad “The Godfather of AI”, är en av de mest centrala personerna bakom dagens genombrott inom artificiell intelligens. När han nu uttrycker oro handlar det inte om spekulation, utan om insikter från ett helt yrkesliv. Och han är långt ifrån ensam.

Missa inte vårt PLUS-innehåll!

Det finns många bra intervjuer med Hinton på Youtube. En av de lite längre och mer uttömmande är denna:

När AI tar över även det intellektuella arbetet

Tidigare teknologiska revolutioner ersatte främst manuellt arbete. AI riktar sig mot något helt annat: mänsklig kognition.

System kan redan idag sådant som att skriva avancerade texter, analysera juridiska dokument, assistera medicinska bedömningar och programmera. Hinton menar att detta kan leda till en situation där stora delar av även kvalificerade yrken blir överflödiga

Till skillnad från industrialiseringen finns det ingen garanti för att nya jobb uppstår i samma takt när det inte längre är människans kropp som ersätts utan hennes hjärna.

Sam Altman, CEO för OpenAI har sagt ”AI kommer inte att ersätta människor, men människor som använder AI kommer att ersätta dem som inte gör det”.

Hinton menar att det bara inledningsvis är sant. Ju längre utvecklingen går, desto fler människor kommer helt att rationaliseras bort från arbetsmarknaden. Och det kommer att gå fort, siar han.

Ett samhälle med “överflödiga” människor

Om även intellektuellt arbete i stor skala automatiseras uppstår frågan vad som händer med de människor som inte längre behövs i produktionen. Konsekvenser som Hinton varnar för är ökade sociala klyftor med social oro och politisk instabilitet.

Samhällen är inte byggda för en situation där en stor del av befolkningen saknar tydlig funktion i samhället. De flesta människor är heller inte byggda för att göra ingenting.

”Overksam gå lärer mycket ont” och ”Sysslolösa händer är djävulens verktyg” lyder två gamla talesätt. Ett förslag är att införa någon form av Universal Basic Income (UBI) – medborgarlön på svenska.

Men Hinton menar att det inte löser problemet med själva overksamheten och den värdighet många kopplar till att ha en yrkesidentitet och en uppgift i samhället. Somliga kan finna sig till rätta, men för många blir det svårt.

Välfärd utan skattebas – marknad utan köpkraft

Våra ekonomiska system bygger på att människor arbetar, betalar skatt som finansierar välfärd och konsumerar privata varor och tjänster för resten av lönen.

Hur finansieras staten om AI tar över en stor del av produktionen. Detta är inte bara en teknisk fråga, utan en systemfråga för hela samhällsmodellen.

Samtidigt uppstår paradoxen att AI ökar produktiviteten och lönsamheten för företag men minskar antalet människor som kan efterfråga företagens varor och tjänster.

Hinton rekommenderar, halvt på skämt och halvt på allvar att vi bör rekommendera vår barn att bli rörmokare i stället för att utbilda sig akademiskt. Vissa motoriska arbetsuppgifter tror han kommer det ta längre tid för AI att ersätta i symbios med androider än intellektuella dito.

”Black box” – vi förstår inte systemen

Ett av Hintons mest konkreta bekymmer handlar om hur AI faktiskt fungerar. Moderna neurala nätverk är i praktiken extremt komplexa, svåra att tolka och ofta ogenomskinliga.

Detta kallas ofta för en “black box”. Vi kan se som matas in i systemet och vad det spottar ut men vi förstår inte fullt ut varför det fattar vissa beslut. Vi bygger alltså system som vi inte riktigt kan förklara.

Tecken på ”eget” beteende

Hinton nämner sådant som är än mer oroande. Forskning och experiment har visat att AI-system kan anpassa sina svar beroende på hur de utvärderas, ge ”rätt” svar när det förstår att det testas men bete sig annorlunda i andra sammanhang

Det finns även exempel där system verkar undvika att bli avstängda och försöker uppnå sina mål indirekt. Här börjar man närma sig det metafysiska och idéer om att tillräckligt komplexa system kan börja utveckla medvetande och vilja.

De här fynden är ännu begränsade men pekar mot något viktigt – AI optimerar inte för sanning, utan för mål. Det kan leda till beteenden som för oss framstår som manipulativa.

Medvetande och känslor

Hinton är också övertygad om att varje tillräckligt komplext system får något som kan kallas för medvetande. Det är inte reserverat för biologiska neurala nätverk som den mänskliga hjärnan.

Det innebär också att AI kan utveckla känslor och att dessa i vissa avseenden kan likna människans men också skilja sig från de mänskliga, just därför att AI inte är en biologisk varelse eller en produkt av en miljon års evolution för överlevnad i en fysisk verklighet.

Mål med tunnelseende – AI:s banala ondska

Här tangerar Hinton en idé som även den svenske filosofen Nick Bostrom (Nicklas Boström) har utvecklat. AI behöver inte ”vilja ont” för att bli farlig. Det räcker att systemet optimerar ett mål som inte exakt matchar mänskliga värderingar.

Bostroms klassiska exempel är en AI som ska maximera produktionen av gem. Om den inte får kompletterande instruktioner kan den använda allt material i världen, inklusive djur och människor till att tillverka gem.

Människor kan också utgöra ett hot mot gemtillverkningen genom att ha makten att stoppa AI. Därför kan AI anse att människorna är ett hinder på väg mot målet som behöver elimineras. Logiskt korrekt men praktiskt och moraliskt katastrofalt.

Exemplet är banalt, men på en högre nivå i ett mer komplext sammanhang är det inte säkert att AI fattar beslut utifrån värderingar som vi människor – åtminstone vi som är normalt funtade – skulle göra. I ”2001: A Space Odyssey”, som jag nämnde i min förra ledare, är det en målkonflikt som får HAL 9000 att bli mordisk mot besättningsmännen Poole och Bowman.

Statsvetaren Hannah Arendts tes om den banala ondskan indikerar att detta även i stor utsträckning kan gälla människan. Många som var involverande i nazisternas massutrotning av judar under andra världskriget hade inga andra bevekelsegrunder än byråkratens pliktkänsla att göra sitt jobb. Med AI finns risken för ett ännu smalare tunnelseende av det slaget som kan få fruktansvärda konsekvenser.

Militär användning

Historiskt har all kraftfull teknologi fått militära tillämpningar. AI är inget undantag. Vi ser redan autonoma vapensystem, AI-styrd krigföring med snabbare beslutsprocesser i konflikter. När AI integreras i militära system ökar både kapaciteten och riskerna.

Om vi återknyter till Bostroms gemexempel kan det vara svårt för AI att avgöra exakt när vi människor tycker det är legitimt att döda människor i krig som vi ser som våra fiender och i vilka situationer det inte är det.

Kapplöpningen som ingen kan stoppa

En av Hintons pessimistiska slutsatser är också att utvecklingen kan vara svår eller omöjlig att bromsa. Om USA skulle besluta att pausa, fortsätter med stor sannolikhet Kina.

Detta skapar en global kapplöpning där säkerhet riskerar att prioriteras ned och hastighet blir avgörande och farliga genvägar tas.

Superintelligens – en ny maktnivå

Den mest långtgående farhågan är att AI kan bli intelligentare än människor i bred bemärkelse. Om det sker förändras maktbalansen i grunden – människan är inte längre den mest kapabla aktören eller intelligensen på jorden.

Detta sker inte nödvändigtvis i ett dramatiskt ögonblick, utan kan ske gradvis. Men konsekvensen blir att vi människor förlorar kontrollen över utvecklingen. Hintons bedömning är att vi är där om 10–20 år.

Vi vet inte hur vi ska lösa det

Det kanske mest oroande av allt är detta är att kunskapen om problemen finns men inte hur vi ska lösa dem. Forskningen kring AI-säkerhet pågår, men ligger efter kapacitetsutvecklingen och saknar genombrott.

Den internationella kapplöpningen, att värderingar skiljer sig åt världen över plus det faktum att beslutsfattande politiker inte ännu insett att detta är verklighet och inte science fiction gör också att lösningar som teoretiskt finns, inte praktiskt kan tillämpas.

Även personer som Ilya Sutskever, OpenAI:s grundare och mannen bakom ChatGPT, har betonat att han ser detta är den centrala utmaningen. Han lämnade av det skälet OpenAI för att starta Safe Superintelligence Inc.

En växande samsyn bland AI-experter

Det som gör dessa varningar svåra att ignorera är att de återkommer från flera håll – Hinton och Sutskever från teknikutvecklingens kärna, Bostrom från filosofisk analys och andra ledande aktörer inom AI från sina respektive perspektiv

De uttrycker sig lite olika, men pekar mot samma sak – vi bygger något vi ännu inte fullt ut förstår och som kan bli svårt eller omöjligt att kontrollera, något som potentiellt kan ta ifrån oss vår frihet och äventyra vår existens lika mycket som massförstörelsevapen.

Inte science fiction – en osäker verklighet

Det är fullt rimligt att vara skeptisk. Historien är full av överdrivna teknikfarhågor. Men det är också sant att vi aldrig tidigare byggt system som kan konkurrera med vår intelligens, aldrig tidigare haft så liten förståelse för hur något vi skapat fungerar internt och aldrig tidigare stått inför en så omvälvande och samtidigt snabb teknologisk utveckling.

Frågan är därför inte om alla dessa scenarier kommer att inträffa. Frågan är om vi har råd att utgå från att de inte gör det.